[ad_1]

Fuente: Andrea De Santis/Unsplash

Antes de Internet (para los que recordamos), encontrar información era mucho más difícil. Si desea investigar un tema, especialmente uno complejo, puede ser una tarea bastante desalentadora. A menudo tenía que depender de fuentes tradicionales como libros, revistas científicas o conexiones personales con personas bien informadas. Por lo tanto, las personas con conocimientos o habilidades especiales eran muy valoradas porque poseían información que no estaba disponible para todos.

Internet ha revolucionado la disponibilidad y distribución de la información. Esto hizo que una gran cantidad de conocimiento estuviera disponible para cualquier persona con una conexión a Internet, que solo creció a medida que aumentaba la velocidad de Internet. Los motores de búsqueda y las bases de datos en línea han permitido que las personas encuentren rápidamente información sobre casi cualquier tema, lo que reduce la necesidad de depender de la experiencia de unos pocos elegidos.

Pero Internet también ha traído problemas para determinar la confiabilidad y precisión de la información. Aquellos sin suficiente experiencia para distinguir lo que era creíble de lo que no lo era, podrían investigar fácilmente su camino hacia conclusiones cuestionables (por ejemplo, la Tierra es plana, las vacunas causan autismo). Y hemos visto un aumento en las personas que afirman haber «hecho su propia investigación» para respaldar sus puntos de vista, independientemente de la legitimidad de los puntos de vista que propugnan.

Si bien Internet ha hecho que la información sea más accesible, también ha aumentado la importancia del conocimiento experto para ayudar a las personas a comprender la gran cantidad de información disponible. La experiencia permitió una comprensión más profunda, el análisis y la generalización del conocimiento, lo que permitió a las personas tomar decisiones más informadas y navegar temas complejos de manera más efectiva.

Avance rápido hasta hoy y mayor disponibilidad AI– herramientas gestionadas para la investigación y Toma de decisiones. Si bien muchas de estas herramientas tienen capacidades muy limitadas, la introducción de una IA más amplia como Bard y ChatGPT permite a las personas omitir el proceso de investigar un tema y desarrollar un argumento e ir directamente a una conclusión o solución. Sin embargo, los peligros de esto se han vuelto completamente evidentes recientemente, como cuando el profesor está equivocado. despidió a todos sus alumnos por hacer trampa (porque ChatGPT le dijo que sí) o el abogado que usó ChatGPT para investigación legal solo para descubrir que los casos que citó no existían (luego fue sancionado).

Pero incluso en la escala más limitada de la IA, vemos que la IA hace recomendaciones, como a quién despedir o si a alguien se le deben negar los opioides debido a la sospecha de abuso (sobre lo que escribí aquí). Dicho uso depende de la suposición de que la salida de IA se basa en datos de audio y lógica para producir este resultado, que a menudo es imposible de verificar (Papazoglú, 2023).

Todo lo cual me lleva de vuelta al título de este post. Si bien la IA facilita la toma de decisiones de subcontratación, existe una gran variabilidad en la calidad de los resultados que producirá cualquier IA. Y eso nos deja con una elección. Podemos utilizar entradas de IA de forma predeterminada o tratar las entradas de IA simplemente como una fuente de datos (quizás incluso una fuente importante) en nuestro proceso de toma de decisiones. Tener una experiencia humana legítima hace que la segunda opción sea mucho más factible.

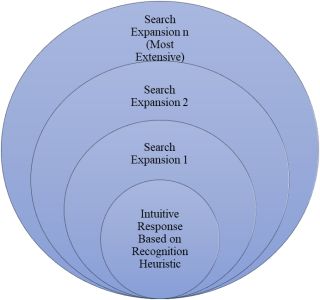

La presencia de la experiencia humana permite evaluar la plausibilidad intuitiva y la razonabilidad del resultado creado por la IA. A pesar de intuición a menudo denigrado en la investigación y la práctica de la toma de decisiones [1]La intuición es el medio por el cual la mayoría de los expertos acceden a su conocimiento. [2] (julio, 2019; Simón, 1987). Como ya escribí durante la discusión. posibles consecuencias negativas limitaciones de la inteligencia artificial en relación con la toma de decisiones humana, las situaciones de toma de decisiones suelen conducir a una reacción intuitiva (Fig. 1). La respuesta intuitiva de los expertos legítimos es mucho más probable que la respuesta intuitiva de los no expertos. Como tal, los expertos están en una mejor posición para evaluar la calidad de los resultados generados por IA y hacer ajustes cuando sea necesario.

Figura 1. Ampliación de la búsqueda de evidencia

Fuente: Matt Gravitch, Ph.D.

Entonces, ya sea que se trate de despidos, prescripción de opioides, atención médica, inversión financiera o cualquier otra decisión compleja, la falta de experiencia humana para juzgar la calidad de lo que produce la IA puede conducir a la aceptación total de ese resultado. argumento creado por ChatGPT o una recomendación para negar los opioides a un paciente. Pero ningún algoritmo será preciso el 100 por ciento del tiempo. Siempre habrá algún grado de error. Por lo tanto, la experiencia humana proporciona una validación de los resultados de la IA, ya que los humanos, no la IA, experimentan las consecuencias de las decisiones tomadas.

Un ejemplo benigno es el uso de GPS, una herramienta de toma de decisiones basada en inteligencia artificial. Para la mayoría de los viajes, un GPS proporcionará una ruta razonable para llevar a alguien de A a B y hacerlo con precisión. También ofrecerá una hora estimada de llegada (ETA), que, si todo sale según lo planeado, es probable que también sea razonablemente precisa.

Pero lo que no puede tener en cuenta con precisión son las posibles ralentizaciones no planificadas, la duración exacta de la ralentización esperada (por ejemplo, en una zona de trabajo) [3], o cuánto tardará en encontrar un lugar para estacionar. Si alguno de estos factores se vuelve relevante, es probable que la ETA sea menos precisa (menos variará). Por lo tanto, si bien un conductor puede confiar en el GPS para ayudar a planificar una ruta y determinar una hora de salida, la propia experiencia del conductor, en forma de experiencia con la ruta a tomar y el terreno donde se encuentra el punto final, será relevante en decidir si tomar una ruta GPS predeterminada, cambiar la ruta mientras conduce y planificar tiempo extra para estacionar [4]. El GPS proporciona información para las decisiones del conductor, pero no toma esas decisiones por el conductor. Y aquellos conductores con más experiencia podrán reconocer mejor cuándo se deben considerar factores fuera de la entrada del GPS.

De ninguna manera estoy afirmando que el juicio humano experto sea infalible. Como he escrito en el pasado, la experiencia tiene sus limites. Pero el juicio de expertos permite la consideración de posibles factores aleatorios o específicos de la situación que pueden ser relevantes para una situación de toma de decisiones dada. Y estos factores a menudo son importantes para determinar la aceptabilidad de varias opciones de decisión, las compensaciones que pueden acompañarlas y las posibles consecuencias no deseadas, ninguna de las cuales puede predecirse fácilmente mediante un algoritmo.

Pero la experiencia también puede guiar el proceso de expansión de la búsqueda que se muestra en la Figura 1. Cuando la IA produce un resultado potencialmente válido que necesita verificación adicional, los expertos generalmente están en una mejor posición para determinar a dónde ir para obtener esa verificación. Entonces, la experiencia humana es útil no solo para evaluar o mejorar intuitivamente los resultados de la inteligencia artificial; también es útil para dirigir la búsqueda de evidencia o información adicional para verificar, confirmar o refinar este resultado cuando sea necesario.

Birhane y Raji (2023) argumentó que cuando los modelos de lenguaje grandes como ChatGPT o Bard cometen errores predictivos, las consecuencias pueden ser bastante graves [5]. Pero lo mismo ocurre con cualquier herramienta impulsada por IA. Si los tomadores de decisiones carecen de la experiencia para examinar de manera significativa la entrada de IA, ya sea una línea de código, un documento de capacitación interna o una recomendación de préstamo hipotecario, es más probable que tomen decisiones equivocadas. Y a veces las decisiones equivocadas tienen consecuencias graves. Poner todos nuestros huevos glorificados en la cesta de la IA y usar la IA como predeterminada para tales decisiones es una receta para errores de alto riesgo. Y aunque la experiencia humana tiene sus limitaciones, puede crear ciertas coberturas para reducir la probabilidad de tales errores.

[ad_2]

Source link